Как мошенники генерируют фото, видео и голос родных с целью заполучить деньги

Мошенники используют дипфейки в своих схемах, когда вымогают деньги у россиян. В МВД рассказали, как распознать такой вид технологий.

Дипфейк – это методика создания фото, видео или голоса с помощью искусственного интеллекта.

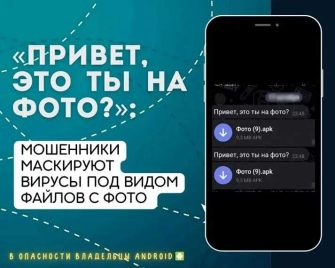

У такого вида мошенничества есть несколько признаков. Например, явным сигналом того, что вместо живого человека используется нейросеть, является неестественная интонация речи, она может показаться «роботизированной», а также слишком редкое моргание. Помимо этого, стоит обратить внимание, если собеседник обращается к вам с нетипичной просьбой.

Определить, что с вами контактирует мошенник, использующий искусственный интеллект, можно, внимательно присмотревшись к губам. Произносимая в видеозаписи речь не совпадает с движением рта. Стоит насторожиться, если просьба от якобы вашего знакомого поступает через нестандартные каналы связи.

Если действительно нужно перевести деньги близкому, не постесняйтесь перезвонить ему по его личному номеру и удостовериться, нуждается ли он в переводе прямо сейчас.

Следить за новостями удобнее на наших страницах в ВК, ОК и Телеграм. Подписывайтесь!

Популярные новости Шолоховского района